আপনি যদি নেটিভ AI-তে আগ্রহী হন, তাহলে AI-এর সাথে খেলার জন্য আপনার সত্যিই আর একটি বিশাল RTX কার্ডের প্রয়োজন নেই—এবং আমি আশা করি যে কেউ আমাকে এটি আগে বলত। দীর্ঘদিন ধরে, আমি ধরে নিয়েছিলাম যে স্থানীয় AI মডেলগুলি চালানোর জন্য একটি গুরুতর GPU, ক্লাউড ক্রেডিট বা উভয়েরই প্রয়োজন।

যে কেউ বিনামূল্যের অ্যাপের মাধ্যমে স্থানীয় এলএলএম-এর সুবিধা নিতে পারে, কিন্তু মডেলটি সম্পূর্ণ ভিন্ন ধারণা। তারপরে আমি পরিমাপকৃত মডেলগুলি আবিষ্কার করেছি, এবং হঠাৎ আমার গেমিং ল্যাপটপটি স্থানীয়ভাবে আশ্চর্যজনকভাবে সক্ষম সহকারী চালানোর জন্য যথেষ্ট ছিল, কোন সদস্যতা ছাড়াই এবং আমার মেশিন থেকে কোন ডেটা আসেনি।

এআই চালানোর জন্য আপনার কি সত্যিই একটি দৈত্য GPU দরকার?

প্রশিক্ষণ এবং অনুমানের মধ্যে পার্থক্য

আমাদের মধ্যে বেশিরভাগই একই আখ্যানটিকে অভ্যন্তরীণ করে তুলেছে: আপনি যদি আধুনিক AI মডেলগুলি চালাতে চান তবে আপনি হয় ক্লাউড অ্যাক্সেসের জন্য অর্থ প্রদান করেন বা আপনি উচ্চ-সম্পন্ন GPU-তে গুরুতর অর্থ ব্যয় করেন। এই ধারণাটি সম্পূর্ণরূপে এলোমেলো নয় – সম্পূর্ণ নির্ভুলতার সাথে বড় মডেলগুলির জন্য অনেক বেশি VRAM প্রয়োজন – তবে বেশিরভাগ ব্যবহারিক ব্যবহারের ক্ষেত্রে এটি পুরানো।

কী পরিবর্তন হয়েছে তা হল মডেলগুলি অকেজো খেলনা না হয়ে ছোট এবং আরও দক্ষ হয়ে উঠেছে এবং তাদের চারপাশের সফ্টওয়্যারগুলি পরিপক্ক হয়েছে৷ আপনি এখন 1B থেকে 9B প্যারামিটার পরিসরে সত্যিই দরকারী মডেলগুলি পেতে পারেন যা ল্যাপটপ এবং ডেস্কটপে চালানোর জন্য ডিজাইন করা হয়েছে, ডেটা-সেন্টার হার্ডওয়্যার নয়।

কোয়ান্টাইজেশন মেমরিতে সেই মডেলগুলিকে সঙ্কুচিত করে এটিকে আরও এগিয়ে নিয়ে যায়, যা খসড়া তৈরি, কোডিং সহায়তা এবং নোট নেওয়ার মতো দৈনন্দিন কাজের গুণমানের উপর আশ্চর্যজনকভাবে সামান্য প্রভাব ফেলে। আপনি যখন ছোট, স্মার্ট আর্কিটেকচারকে ভাল কোয়ান্টাইজেশনের সাথে একত্রিত করেন, তখন প্রবেশের বাধা একটি গেমিং ওয়ার্কস্টেশন থেকে একটি ভাল CPU এবং পর্যাপ্ত র্যামে চলে যায়। আপনার ইতিমধ্যে থাকা একটি মেশিন হঠাৎ করে একটি সম্পূর্ণ কার্যকরী এআই বক্সে পরিণত হয়।

|

নমুনা |

আকার (প্যারামিটার) |

জন্য ভাল |

4-বিট কোয়ান্টাইজেশন সহ সাধারণ RAM |

নোট |

|---|---|---|---|---|

|

Fi‑3.5 Mini / Fi‑4 Mini |

~3.8B-4B |

সাধারণ চ্যাট, যুক্তি, কোডিং স্নিপেট |

মসৃণ ব্যবহারের জন্য প্রায় 4-6GB |

Microsoft এর ছোট মডেল সিরিজ, সীমিত হার্ডওয়্যার এবং অফলাইন পরিস্থিতির জন্য ডিজাইন করা হয়েছে। |

|

লামা 3.2 1B/3B নির্দেশাবলী |

1B/3B |

লাইটওয়েট, কম RAM ল্যাপটপ |

4‑বিটে 3B এর জন্য সর্বনিম্ন ~3-4GB |

ওলামা এবং GPT4All-এর মাধ্যমে ল্যাপটপে Meta-এর Run Anywhere ভেরিয়েন্ট ব্যাপকভাবে প্রদর্শিত হয়েছে। |

|

Qwen2.5‑7B নির্দেশাবলী |

7 খ |

সাধারণ সহকারী, স্ট্রাকচার্ড টাস্ক, লাইটিং এনালাইসিস |

4-বিটে প্রায় 5-8 GB |

প্রায়ই দৈনন্দিন কাজের জন্য ডিফল্ট স্থানীয় মডেল হিসাবে সুপারিশ করা হয়। |

|

GLM‑4‑9B |

9 খ |

শক্তিশালী যুক্তি এবং বহুভাষিক কাজ |

4-বিটে প্রায় 8-10GB |

ল্যাপটপের জন্য একটি সুষম ছোট-কিন্তু-গুরুতর মডেল হিসাবে হাইলাইট করা হয়েছে। |

|

জেমা-স্টাইল 2B-4B মডেল |

2B-4B |

চ্যাট, নোট নেওয়া, সহজ কোডিং সাহায্য |

4-বিটে প্রায় 3-6GB |

Google-সমর্থিত ছোট মডেল যা ভোক্তাদের ডিভাইসে সহজে চলে। |

মনে রাখবেন যে এই সংখ্যাগুলি কঠিন সীমা নয়। আপনার যদি পর্যাপ্ত RAM থাকে (16GB বা তার বেশি), 3B থেকে 7B মডেলগুলি একেবারে 4-বিটে উপলব্ধ। 32 জিবি বা তার বেশি মেমরি কোনো নাটক ছাড়াই 7B থেকে 9B মডেলের দরজা খুলে দেবে।

কোয়ান্টাইজেশন আসলে কি করে?

ভাঙা ছাড়াই মডেলের আকার হ্রাস করা

ফণার নীচে, একটি ভাষা মডেল হল ওজন নামক সংখ্যার বিশাল স্তূপ। ঐতিহ্যগতভাবে, এই সংখ্যাগুলি 16 বা 32-বিট ফ্লোটিং পয়েন্ট ফর্ম্যাটে সংরক্ষণ করা হয়, যা নির্ভুলতার জন্য দুর্দান্ত তবে মেমরি ব্যবহারের জন্য ভয়ানক। যদি প্রতিটি ওজন একটি উচ্চ-নির্ভুল সংখ্যা হয় এবং আপনার কাছে সেগুলির বিলিয়ন বিলিয়ন থাকে, তাহলে আপনার কাছে মডেল ফাইল রয়েছে যেগুলির ওজন বেশ কয়েকটি গিগাবাইট এবং সমানভাবে বিশাল VRAM বা RAM ফুটপ্রিন্টের দাবি করে৷

কোয়ান্টাইজেশন একটি সহজ প্রশ্নের উপর ভিত্তি করে: আপনার কি সত্যিই প্রতিটি ওজনের জন্য এত নির্ভুলতা প্রয়োজন? প্রতিটি সংখ্যা 16 বিট সহ সংরক্ষণ করার পরিবর্তে, আপনি এটি 8 বিট বা 4 বিট দিয়ে সংরক্ষণ করুন। উচ্চ-নির্ভুলতা বিন্যাসের তুলনায়, এটি একা মডেলের আকার অর্ধেক বা 75 শতাংশ পর্যন্ত কমাতে পারে।

চতুর বিষয় হল আধুনিক কোয়ান্টাইজেশন স্কিম সবকিছুকে বোকামি করে না; তারা মিশ্র নির্ভুলতা, প্রতি-চ্যানেল স্কেলিং, এবং সতর্ক ক্রমাঙ্কনের মতো কৌশলগুলিকে একত্রিত করে যাতে মডেলটি তার বেশিরভাগ আসল আচরণ ধরে রাখে। বেঞ্চমার্ক এবং মূল্যায়নে, ভালভাবে টিউন করা 4-বিট এবং 8-বিট ভেরিয়েন্টগুলি প্রায়ই আশ্চর্যজনকভাবে তাদের পূর্ণ-নির্ভুল পিতামাতার কাছাকাছি থাকে, যখন চালানোর জন্য নাটকীয়ভাবে হালকা হয়।

ব্যবহারিক পরিভাষায়, এর মানে হল যে আপনার পরিমাপকৃত মডেল এখনও ভাল কোড মন্তব্য লেখে, ধারণা ব্যাখ্যা করে এবং সঠিকভাবে ইমেলগুলি খসড়া করে, কিন্তু এটি এখন ডিস্কে এবং মেমরিতে আরামদায়কভাবে ফিট করে। বিশাল VRAM সহ হাই-এন্ড GPU-এর প্রয়োজনের পরিবর্তে, এটি একটি সাধারণ ডেস্কটপ বা ল্যাপটপে সিস্টেম র্যামে বসতে পারে এবং ইন্টারেক্টিভ গতিতে সাড়া দিতে পারে।

হ্যাঁ, আপনি CPU-তে এই মডেলগুলি চালাতে পারেন

একটি জিপিইউ থাকা ভাল, তবে একটি কঠিন প্রয়োজনীয়তা নয়

যদি আপনার প্রত্যাশা যুক্তিসঙ্গত হয় তবে আপনার মোটেও একটি GPU দরকার নেই। বর্তমান প্রজন্মের অনুমান লাইব্রেরি এবং ব্যাকএন্ডের সাহায্যে, আপনি একটি সিপিইউতে সম্পূর্ণরূপে কোয়ান্টাইজড মডেলগুলি চালাতে পারেন, যতক্ষণ না আপনার কাছে একটি আধুনিক মাল্টি-কোর প্রসেসর এবং যথেষ্ট পরিমাণে RAM থাকে। একটি চার থেকে আট-কোর ডেস্কটপ বা ল্যাপটপ CPU 16 GB র্যামের সাথে যুক্ত ছোট মডেলের সাথে শুরু করার জন্য যথেষ্ট। আরও RAM, যেমন 32 GB বা তার বেশি, আপনাকে বড় RAM নিয়ে পরীক্ষা করার জন্য আরও জায়গা দেয়।

এই সরঞ্জামগুলি নিম্ন-স্তরের অপ্টিমাইজেশানের উপর ব্যাপকভাবে নির্ভর করে। আপনার সিপিইউ থেকে যতটা সম্ভব পারফরম্যান্স চেপে নিতে তারা ভেক্টরাইজড নির্দেশাবলী, দক্ষ মেমরি ম্যাপিং এবং মাল্টি-থ্রেডিং ব্যবহার করে। ফলাফল হল যে একটি 4-বিট বা 8-বিট মডেল যা 3B থেকে 7B রেঞ্জের মধ্যে হতে পারে একটি সাধারণ মেশিনে খুব দরকারী হয়ে ওঠে। আপনি বিশাল ব্যাচের কাজের মাধ্যমে ব্লাস্টিং হবেন না, তবে একটি ইন্টারেক্টিভ চ্যাট উইন্ডো, একটি লেখার সহচর, বা একটি কোডিং সহকারীর জন্য, একটি ডেডিকেটেড GPU ছাড়াই প্রতিক্রিয়া সময় পুরোপুরি গ্রহণযোগ্য।

কোয়ান্টাইজড মডেল কি সত্যিই ভাল?

স্থানীয়ভাবে লেখা, সংক্ষিপ্তকরণ এবং কোডিং সহায়তা

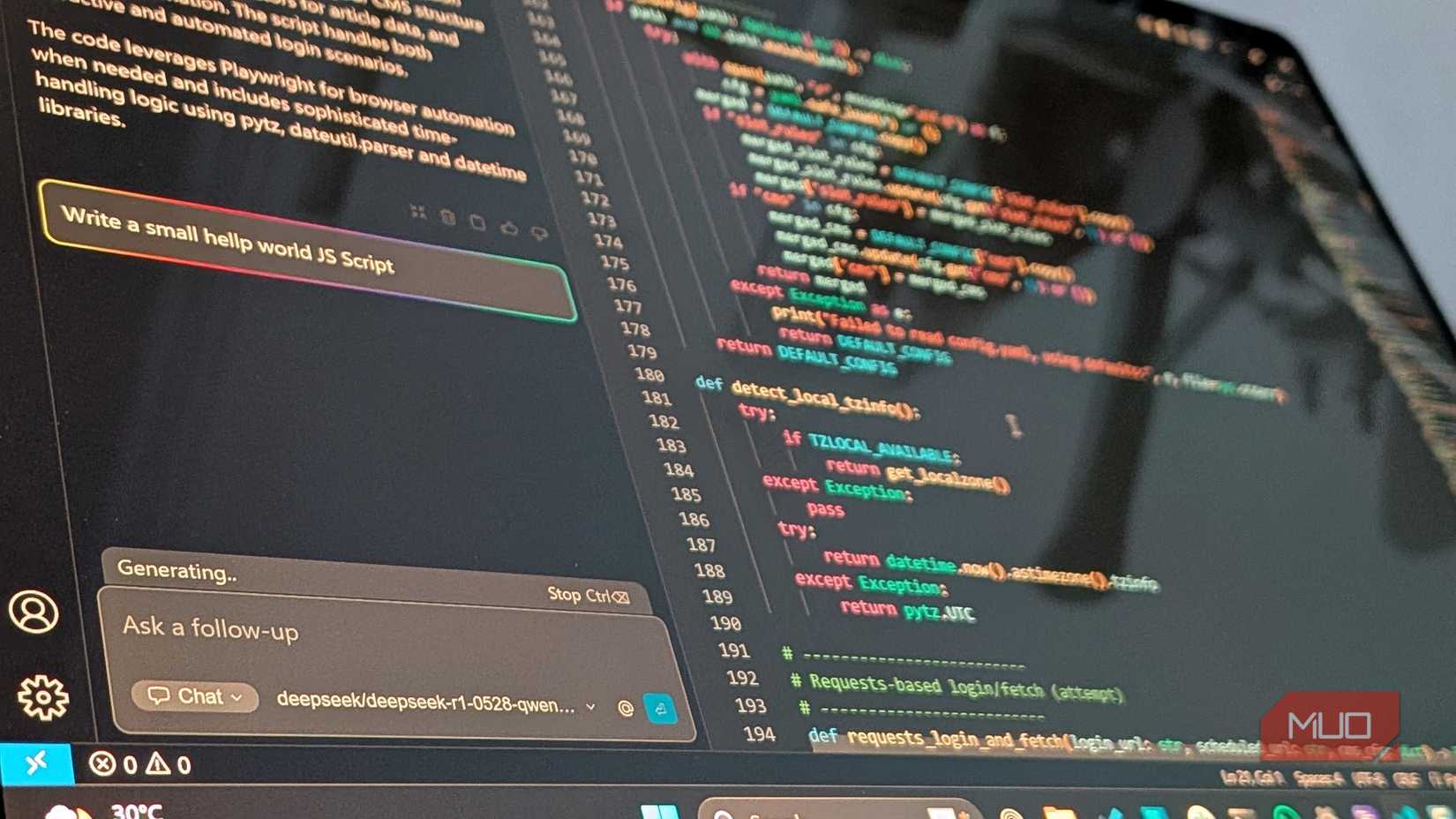

আপনি যদি GPT-4-শ্রেণীর ক্লাউড মডেলগুলিতে অভ্যস্ত হয়ে থাকেন তবে এই ছোট, স্কেল করা মডেলগুলি বাস্তবসম্মতভাবে কী পরিচালনা করতে পারে তা ভাবা ন্যায্য। উত্তরটি হল: আপনার প্রত্যাশার চেয়ে বেশি, বিশেষত ফোকাসড, দৈনন্দিন কাজের জন্য। একটি শালীন মেশিনে, লেখা, কোডিং এবং সাধারণ যুক্তি থেকে যেকোনো কিছু সহজেই পরিচালনা করা যায়। এটি ব্লগের রূপরেখা, খসড়া ইমেল, জটিল অনুচ্ছেদগুলি পুনরায় লিখতে এবং দীর্ঘ নোট বা নথির সারসংক্ষেপ করতে পারে। এটি আপনাকে ত্রুটির বার্তাগুলির মাধ্যমেও নিয়ে যেতে পারে, ছোট কাজের জন্য রিফ্যাক্টরের পরামর্শ দিতে পারে এবং বয়লারপ্লেট বা কনফিগারেশন স্নিপেট তৈরি করতে পারে। এমসিপি টুলের সাহায্যে স্থানীয় এলএলএম ব্যবহার করতে আপনি কতটা নতুন, আকর্ষণীয় উপায়ে ব্যবহার করতে পারেন তার কোনো সীমা নেই।

সাম্প্রতিক ছোট কিন্তু স্মার্ট মডেল যেমন Meta’s Llama 3.2 1B এবং 3B Instruct, Microsoft এর Phi-3.5 Mini, এবং কমপ্যাক্ট Quen এবং Gemma ভেরিয়েন্টগুলি স্পষ্টভাবে এই পরিস্থিতিতে উজ্জ্বল করার জন্য ডিজাইন করা হয়েছে৷ তাদের প্রশিক্ষিত করা হয়েছে এবং প্রজনন করা হয়েছে দক্ষ হওয়ার জন্য, শুধু বড় নয়, তাই যখন ডোজ দেওয়া হয় তখন তারা তাদের ওজনের উপরে পাঞ্চ করে। আপনি অগত্যা লাইভ উদ্ধৃতি সহ একটি সম্পূর্ণ গবেষণা প্রতিবেদন তৈরি করতে তাদের ব্যবহার করবেন না, তবে প্রতিদিনের কাজ এবং চিন্তাভাবনার জন্য, তারা আশ্চর্যজনকভাবে তাদের বড় ভাইবোনের কাছাকাছি বোধ করে।

তাহলে, আপনার কি এখনও একটি GPU দরকার?

যখন একটি GPU সত্যিই জ্ঞান করে তোলে

আপনি যদি স্ক্র্যাচ থেকে বড় মডেলগুলিকে প্রশিক্ষণ দিচ্ছেন, স্কেলে বড় আর্কিটেকচারগুলিকে সূক্ষ্ম-টিউনিং করছেন, বা একটি ফ্ল্যাগশিপ মডেলের প্রতিটি শেষ বেঞ্চমার্ক পয়েন্টকে চেপে দেওয়ার চেষ্টা করছেন, তাহলে হ্যাঁ, একটি শক্তিশালী GPU বা একাধিক, এখনও গুরুত্বপূর্ণ। এই GPU গুলি খুব ভাল। কিন্তু আপনি যদি সত্যিই একজন স্মার্ট লেখার বন্ধু চান, একজন কোডিং সহকারী যিনি আপনার প্রজেক্ট বোঝেন, বা ব্রেনস্টর্মিং, প্ল্যানিং এবং শেখার জন্য একটি ব্যক্তিগত চ্যাট মডেল চান, তাহলে সম্ভবত আপনাকে এখনও একটি অত্যাধুনিক GPU কিনতে হবে না।

আমি আমার পুরানো কম্পিউটার হার্ডওয়্যারে একটি চ্যাটবট চালানোর চেষ্টা করেছি এবং এটি আসলে কাজ করেছে

আপনার পিসিতে এআই চালানোর জন্য আপনার ব্যয়বহুল হার্ডওয়্যারের প্রয়োজন নেই।

আপনার বিদ্যমান মেশিনে চলমান একটি সঠিকভাবে নির্বাচিত কোয়ান্টাইজড মডেল আপনাকে আশ্চর্যজনকভাবে অনেক দূর নিয়ে যাবে। আসল মানসিকতার পরিবর্তন হল এটা মেনে নেওয়া যে AI-কে ক্লাউডে বা GPU-এর র্যাকে থাকতে হবে না। কোয়ান্টাইজেশন এবং সঠিক মডেল বেছে নেওয়ার মাধ্যমে, প্রায় যেকোনো তুলনামূলক আধুনিক মেশিন স্থানীয়ভাবে যুক্তিসঙ্গত গতিতে এআই মডেল চালাতে পারে।